#40 Praxisbericht: Arbeiten mit der lokalen KI!

Worum geht es in diesem Artikel?

Ich möchte einen Blog Post über KI und Social Practices Theorie schreiben, das passt prima zu einem lokalen KI-Workflow

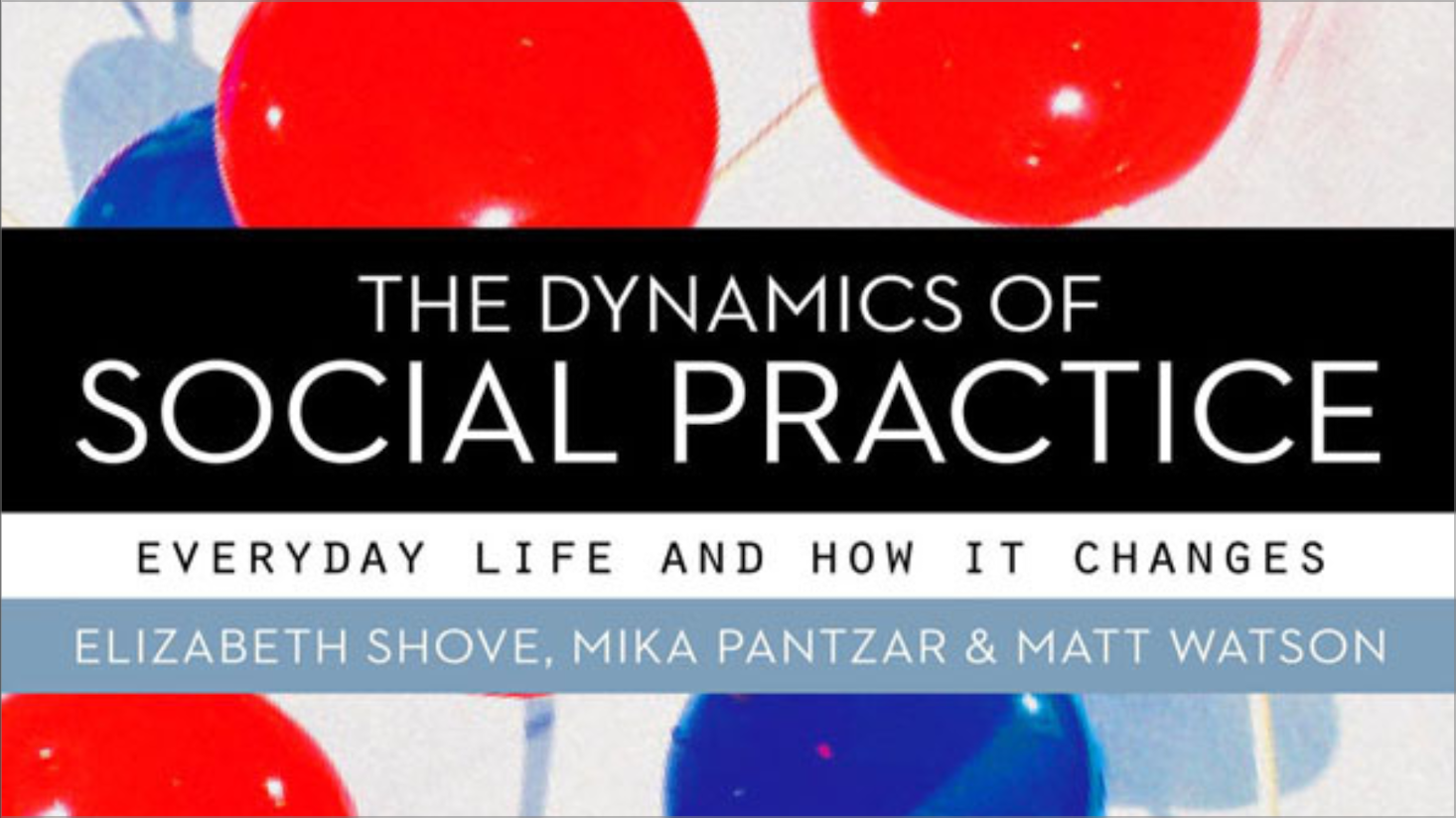

Ich habe von ein paar Jahren ein Buch zur Social Practice Theory gelesen, einfach gesprochen beschäftigt sich die Theorie mit veränderten sozialen und technischen Praktiken.

Kerngedanke ist, nehmen wir ein Beispiel eines menschlichen Druckers vor einigen Jahren, das viel Kompetenz im Kopf des Drucker war und diese Kompetenzen nun in Desktop Publishing Programme gewandert sind, jetzt aktuell in den Sprung zur KI.

Damit verändern sich viele Prozesse und soziale Praktiken für Menschen und Unternehmen.

Die Fragestellungen aus diesem Blickwinkel sind sehr spanned und ich möchte dazu einen Blog Beitrag und Checklisten und Ratgeber entwickeln. Das hilft bei Implementierungen von KI den Rahmen etwas weiter zu fassen.

Ich hatte mir damals einige Kindle Notizen gemacht um schnell wieder anzuschliessen. Schneller Überblick und warum nicht mal mit der KI tiefer in die Analyse gehen.

Workflow zur Analyse der Eingangsfrage mit der KI des Buches zur Social Practices Theorie

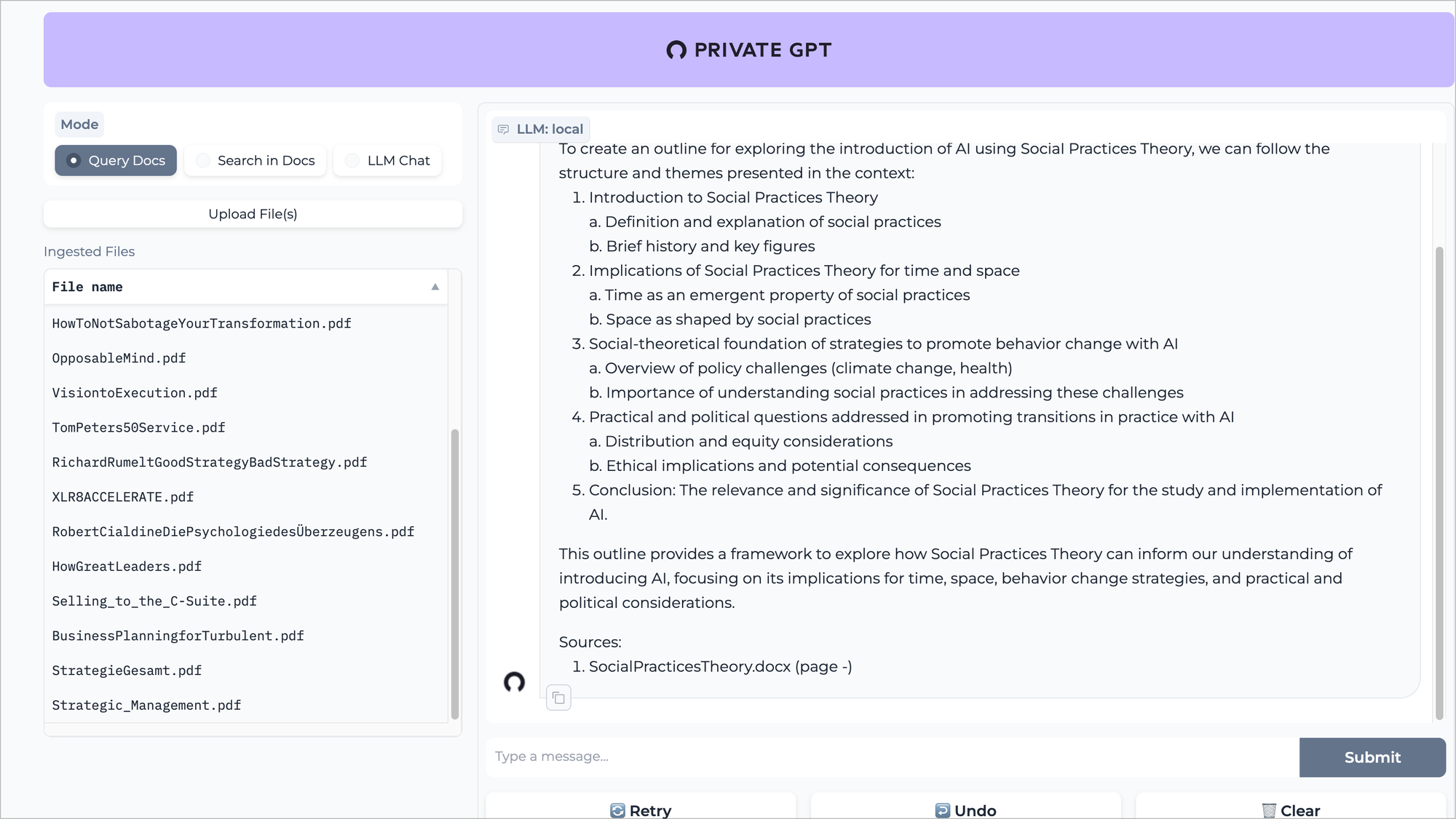

Ich habe mir das Buch gekauft, gescannt und in Private GPT hochgeladen, dort kann ich mit allen Büchern chatten.

Wer mehr über den Workflow wissen möchte, bitte schaut mal hier in diese Blog Post.

Was ich möchte, ist ein strukturiertes Vorgehen:

- Entwicklung einer Outline, welche Fragen machen im Hinblick auf den Fokus Sinn. Hier frage ich direkt Private GPT im gesamten ab.

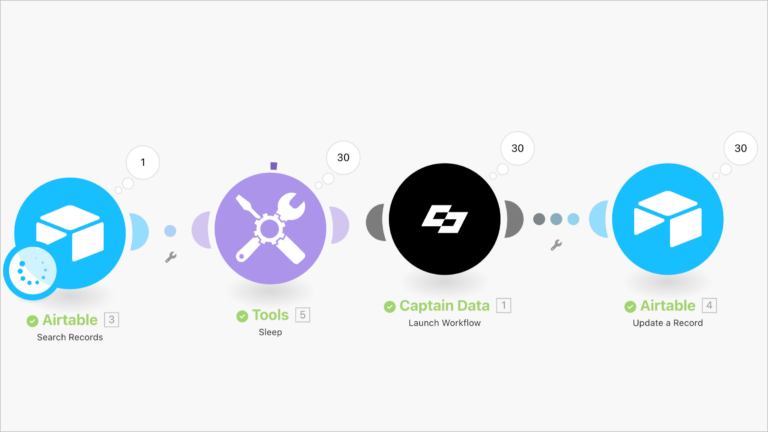

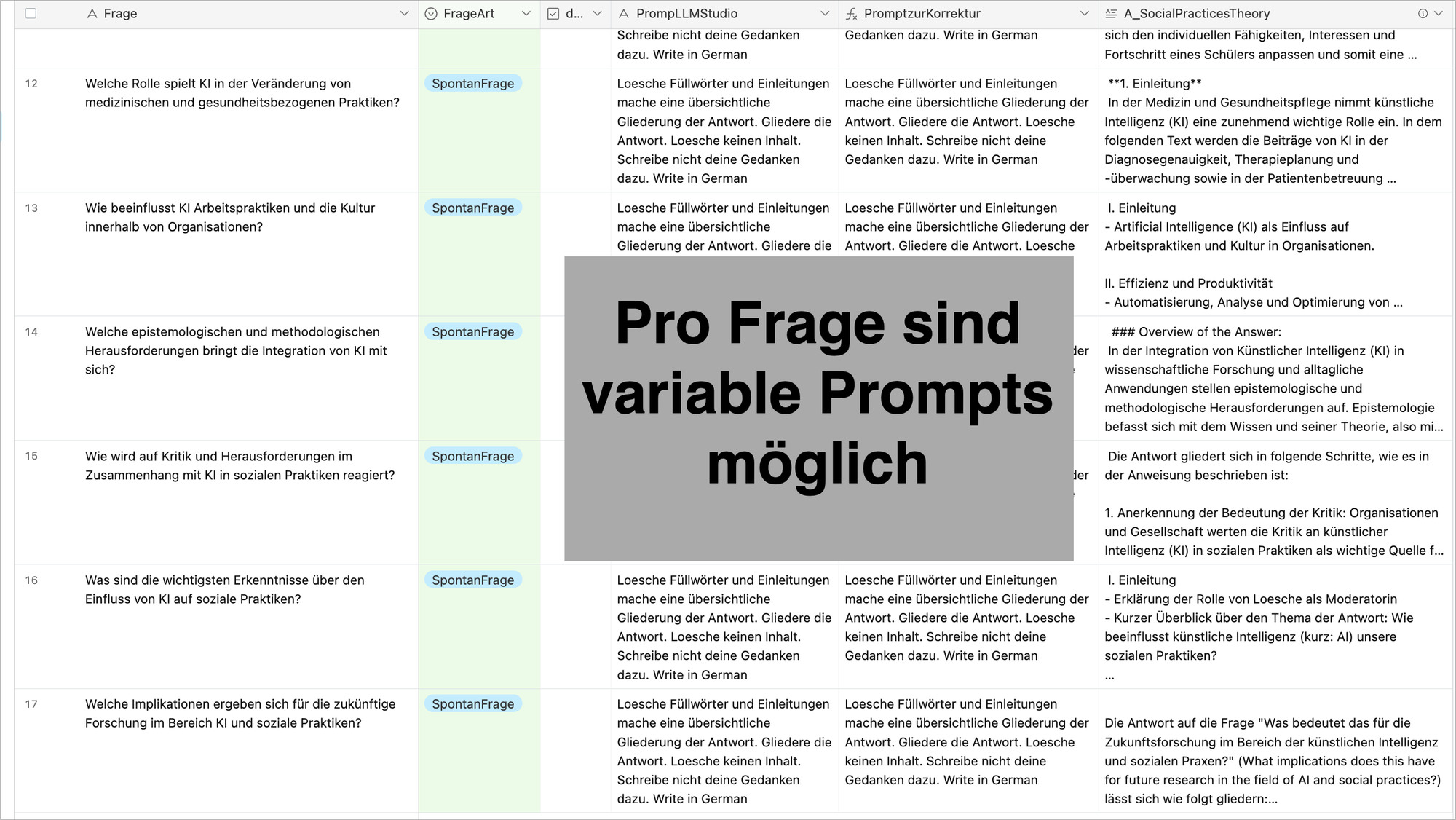

- Übertrag der Fragen in Airtable (copy und Paste, ich könnte natürlich das auch in Airtable machen)

- Klick auf Run und die KI beantwortet die Fragen die ich mir im Hinblick auf die Social Practices Theorie wichtig sind.

- Eine andere lokale KI als Filter integrieren.

Die Ergebnisse der PrivateGPT Datenbank, wo alle Bücher enthalten sind, werden noch mal durch eine zweite lokale KI gefiltert.

Konkret nutze ich LMStudio mit einem Mistral Modell, das läuft vollständig im Speicher auf dem Mac und ist super schnell. Die Standard Einstellung reichen mir vollkommen, vielleicht bin ich aus dem Alter raus, wo man Technik tieferlegt oder neue Felgen anschraubt.

Die Struktur des zweiten Prompts wird direkt über Airtable für jede Frage gesteuert. Manchmal will ich das Mistral eigene Idee einbringt oder auch nur die Form schöner macht.

Wenn die Checkbox do_llm Studio gesetzt ist, dann wird die Frage in den Workflow gegeben, idealweise schreibe ich die Outline in mehreren Fragen in die Tabelle und starte den Workflow, das Skript nimmt dann direkt auch das Kontrollkästchen zurück.

Ich kann in Airtable noch ein schöneres Interface bauen, für Testzwecke reicht das aus.

So bin ich nun mal ganz zufrieden, den Rest kann ich in No-Code Umgebungen machen ohne die Kosten für OpenAI.

Fazit:

Lokale Workflows gelingen super schnell für meine Use-Cases mit mehrstufigen KI Systemen.